cómo pretende limitarla y qué lagunas tiene

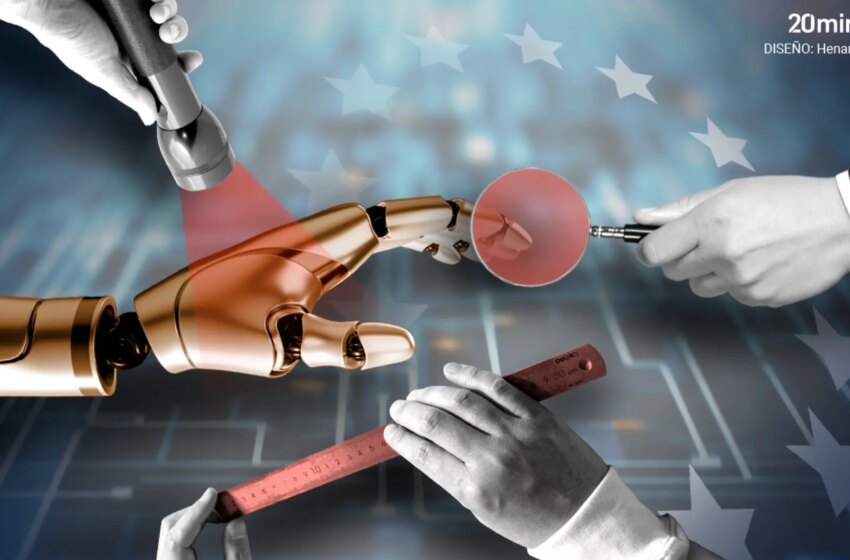

Este viernes, las instituciones de la Unión Europea acordaron la puesta en marcha de una ley de inteligencia artificial, la primera de este tipo, que podrá permitir o prohíbe el uso de esta tecnología a tenor del riesgo que suponga para las personas, y que tiene como fin el impulso de la industria europea ante las de China y EE UU.

Tal y como dijo el viernes Ursula von der Leyen, presidenta de la Comisión Europea, «la ley de inteligencia artificial de la UE es pionera en el mundo. Un marco legal único para el desarrollo de la inteligencia artificial en el que se puede confiar».

El acuerdo se firmó tras 36 horas de negociaciones. El punto más sensible fue el uso que los cuerpos policiales podrán hacer de las cámaras de identificación biométrica en espacios públicos, cuando sea para garantizar la seguridad nacional, siempre que haya autorización judicial previa y la amenaza «genuina y previsible» o «genuina y presente».

Estas cámaras de identificación biométrica se podrán usar para identificar a terroristas, autores de delitos contra el tráfico de personas, explotación sexual y para buscar a las víctimas de estos delitos.

El principal debate de la ley, que tienen que ratificar el Parlamento Europeo y el Consejo de la UE, en cuanto a este asunto, ha sido la presión de los gobiernos para ampliar el número de delitos susceptibles, contra la postura de la Eurocámara, tendente a limitarla.

Por otro lado, la norma prohíbe todos los sistemas de categorización biométrica por creencias políticas, religiosas, filosóficas o por su raza y orientación sexual, ni tampoco por su comportamiento o características personales, ni la inteligencia artificial capaz de manipular el comportamiento humano.

Otras prohibiciones afectan a los sistemas para expandir o crear bases de datos faciales captando datos de manera indiscriminada a través de internet o de grabaciones audiovisuales, y a los sistemas de inteligencia artificial que pueden reconocer las emociones en los centros de trabajo o las escuelas.

Otro aspecto que ha generado debate en la génesis de la ley ha sido la llamada IA generativa, como la que representan herramientas como ChatGPT, de la empresa OpenAI o Bard, de Google.

Estos sistemas tendrán que cumplir criterios de transparencia, y así, deberán especificar que un contenido se ha creado a través de la inteligencia artificial, así como que se respetan los derechos de autor.

Aunque no se prohíbe su uso, la ley ha establecido una serie de criterios para detectar los modelos que pueden generar un alto riesgo antes incluso de que puedan salir al mercado.

De manera paralela, esta ley implica la creación de la Oficina Europea de Inteligencia Artificial, asesorada por un panel de científicos y de organizaciones de la sociedad civil. Esta oficina nacerá de forma inmediata, aunque la ley, que prevé multas de hasta 35 millones de euros, no empezará a aplicarse hasta 2026 .

Las lagunas de la ley, según los expertos

Aunque es una ley pionera que ha intentado atar todos los cabos de una tecnología con un enorme potencial, algunos expertos creen que la norma nace con lagunas que no quedan resueltas.

Borja Adsuara, profesor universitario y experto en derecho digital, dijo a la Agencia EFE que la tramitación del Reglamento no ha terminado y en que comienza ahora una negociación «técnica» y un proceso de traducción que se va a prolongar durante varios meses.

Adsuara cree que, en el caso de la IA generativa, existen «múltiples dudas» y problemas de propiedad intelectual, que tendrán que abordarse en una norma específica sobre propiedad intelectual.

Sobre el asunto de la vigilancia biométrica, Adsuara ha manifestado que lo importante no es sólo la lista de excepciones «sino, sobre todo, saber quién va a vigilar a los que nos vigilan».

Otro experto, Alfonso Valencia, profesor de la Institución Catalana de Investigación y Estudios Avanzados y director de Ciencias de la Vida en el Centro Nacional de Supercomputación (BSC-CNS), dice respecto a la identificación biométrica que se hacen excepciones para temas policiales «que hacen difícil saber dónde acabará el uso de estas tecnologías en la práctica».

Además, Valenciano es muy crítico con el hecho de que la regulación de esta tecnología dejará a Europa muy lejos de la capacidad de Estados Unidos y China. «En este contexto será muy difícil para Europa, donde operan grupos de investigación, pymes y compañías mucho más pequeñas que las americanas, desarrollar sistemas competitivos».

«Dado que no existe ni la iniciativa, ni el presupuesto, ni la unidad de acción, ni la tecnología para crear esos sistemas, parece que la aplicación de las medidas propuestas dejará definitivamente a Europa fuera del desarrollo de los grandes modelos de IA», dijo Valenciano.